LLMは、クラウドか?ローカルか?

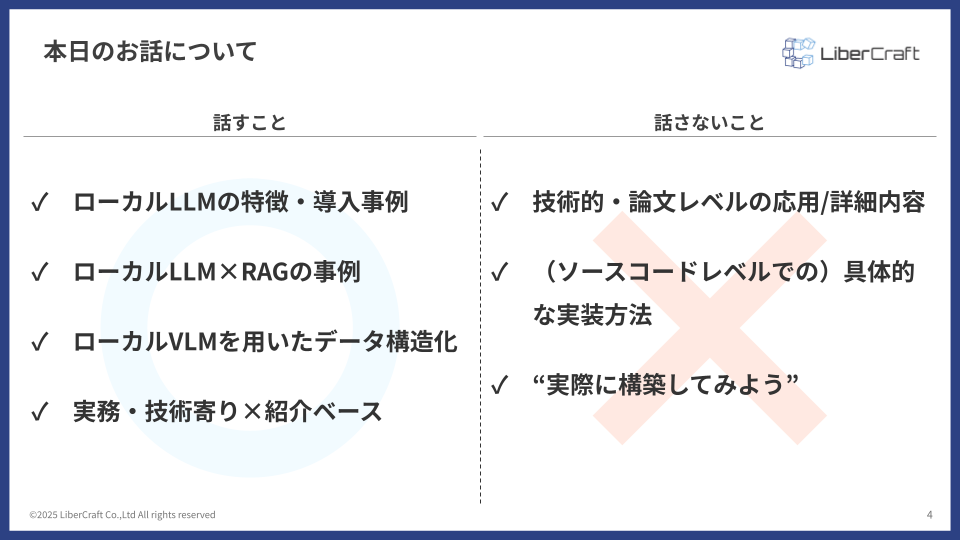

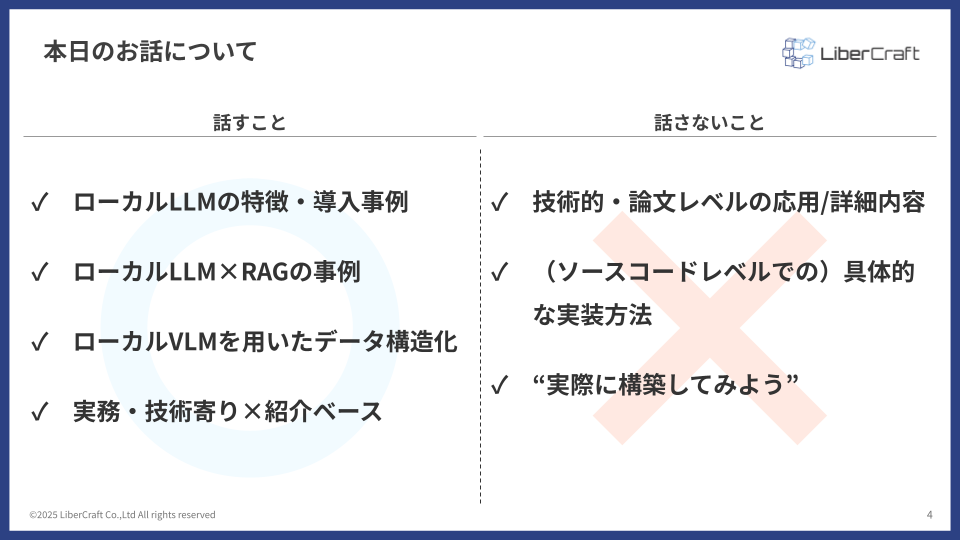

本資料を通してわかること

- クラウドLLMとローカルLLMの比較

- 主要ローカルLLMとオンプレミスサーバーの構築スペック例

- 大量のVoC(顧客の声)テキストデータをローカルLLMで構造化・解析した事例

- セキュリティ要件に対応する閉域RAGシステムのデータ構造化事例

- クラウド/ローカルの判断軸と「スモールスタート」で始める導入ステップ

本資料を通してわかること